Große Teile der wissenschaftlichen Gemeinschaft beschäftigen sich damit, die Auswirkungen von Treibhausgasemissionen und insbesondere von CO2 auf unser vergangenes und zukünftiges Klima zu untersuchen. Um unser zukünftiges Klima zu modellieren, verwenden die Forscher CO2-Emissionen um das zukünftige Klima unseres Planeten einschaetzen zu können. Solche Modelle werden benutzt, um voraszusagen wie viel CO2 Industrie und Haushalte in die Atmospaere abgeben können, um innerhalb des gestzten 1,5°C-Ziels zu bleiben. Die zentrale Frage lautet daher: Wie viel des emittierten CO2 bleibt tatsächlich in der Atmosphäre? Wie viel wird verstoffwechselt oder auf andere Weise gebunden?

Es scheint, daß die bisherigen Modelle die Kapazität der Biomasse unterschätzt haben, CO2 aufzunehmen. Denn jetzt wurden die bisherigen Modelle mit Radiokarbondaten der Atombombentests aktualisiert. Die neuen Daten deuten darauf hin, daß terrestrische Ökosysteme mehr CO2 absorbieren können als bisher angenommen. Bedeutet das, daß die Menschheit nun mehr CO2 emittieren kann?

Forscher des Politechnischen Instituts in Worcester in Massachusetts haben nun ermittelt, daß die Pflanzen jährlich 80 Millionen Tonnen CO2 aufnehmen und publizierten dies kürzlich in einem Artikel im bekannten Wissenschaftsmagazin Science. Das sind 30% mehr als bisher angenommen.

Die Idee der Wissenschaftler war, die Überreste der Atomtests in den 1950er und 1960er Jahren genauer zu untersuchen. Kohlendioxidmoleküle bestehen aus Kohlenstoff und Sauerstoff. Die von den Atombomben hinterlassene Radioaktivität ist auch als radioaktiver Kohlenstoff (14C) nachweisbar. Wie gewöhnlicher Kohlenstoff (12C) ist die radioaktive Version ein möglicher Bestandteil in CO2. Nach den Atombombentests stieg 14C-Anteil in Pflanzen durch die Photosynthese an. Dadurch gelangte Radiokarbon zusammen mit 12C in die Biosphäre an Land. Untersucht man die 14C-Anreicherung, kann man so auch die Raten der CO2-Aufnahme in Pflanzen bestimmen und letztlich, wie auch viel Kohlenstoff neu in die Biosphäre eingetragen wurde.

Tiere, die sich von Pflanzen ernähren, nehmen das selbe CO2 in ihren Organismus sowie Pilze und Bodenbakterien auf. Durch sich zersetztende Biomasse im Boden wird Kohlenstoff in Form von CO2 erneut in die Atmosphäre freigesetzt und der Kreislauf schließt sich.

Die Frage ist jedoch, wie viel CO2 aus der Luft in den Boden gelangt und so langfristig in Biomasse gebunden wird. Die Analysen des radioaktiven Kohlenstoffs zeigen nun, daß kurz nach den Atomwaffentests etwas weniger 14CO2 in der Atmosphäre verfügbar war. Umgerechnet bedeutet das, daß Pflanzen weltweit 80 Milliarden Tonnen Kohlenstoff pro Jahr binden. Bisher gingen die Klimaforscher davon aus, daß die Bindungskapazität 43 bis 76 Milliarden Tonnen betrug.

Die bisherigen Annahmen waren nicht korrekt, da hauptsächlich Baumstämme für die Berechnung verwendet wurden. In Holz gelagerter Kohlenstoff ist seit vielen Jahrzehnten oder Jahrhunderten gebunden. Die neue Studie befaßte sich mit nicht-verholzter Biomasse wie z.B. Blätter, die auch einen großen Anteil an Kohlenstoff binden. Außerdem erhielt die umfangreiche unterirdische Pflanzenbiomasse bisher zu wenig Aufmerksamkeit. In der Regel ist die unterirdische Biomasse vergleichbar mit dem, was sich über dem Erde befindet. Insbesondere wurden bisher nur Holzwurzeln berücksichtigt, nicht aber die viel feinere Rhizosphäre. Die Rhizosphäre stellt einen noch größeren Biomassanteil dar und bindet dementsprechend mehr Kohlenstoff.

Achtzig Milliarden Tonnen sind nicht nur signifikant mehr als in den derzeitigen Klimawandelprognosen. Es ist auch doppelt so viel wie die menschengemachten CO2-Emissionen (37,2 Milliarden Tonnen).

Leider bedeutet dies nicht, daß es nichts gibt, worüber man sich Sorgen machen muß. Lebewesen nutzen auch Biomasse als Energiequelle. Fast die gleiche Menge an CO2 wird wieder freigesetzt, wenn Pflanzen im Herbst ihre Blätter verlieren. Diese Blätter dienen Bodenlebewesen als Nahrungsquelle. Diese natürlichen CO2 -Emissionen aus der Biosphäre haben sich seit den 1960er Jahren stärker beschleunigt.

Insgesamt kann die Photosynthese nur 30% der von Menschen verursachten CO2-Emissionen aus der Atmosphäre binden und daher den Verbrauch fossiler Kraftstoff nicht ausgleichen. Mit großen natürlichen Landflächen für die Photosynthese kann auch mehr CO2 aus der Luft gebunden werden. Infolgedessen solten mehr und nicht weniger Wälder und Wiesen renaturalisiert werden.

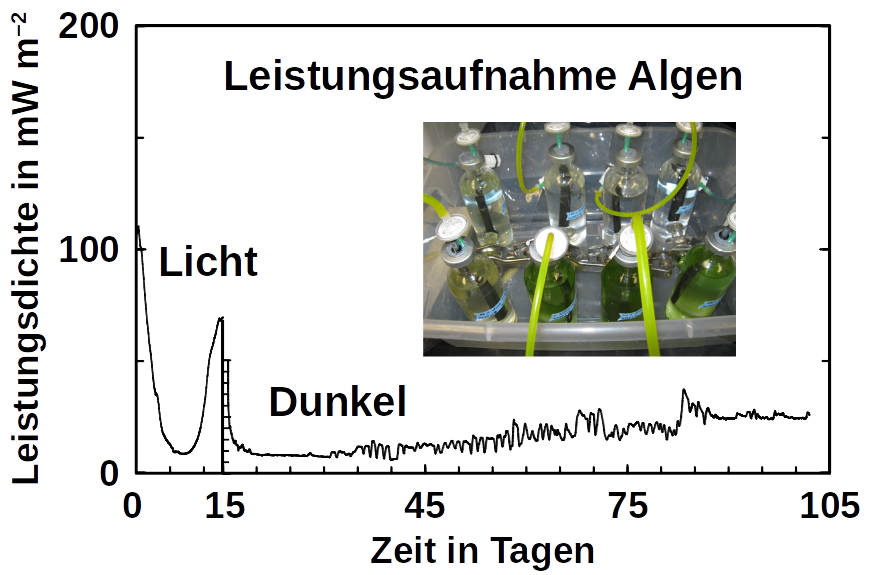

Zwar basieren einige Klimamodelle auf falschen Annahmen. Doch die wichtigere Kohlenstoffspeicherung findet nicht an Land sondern im Wasser statt. CO2 löst sich dort besser auf und unzählige marine Mikroalgen führen ebenfalls Photosynthese durch. Kohlenstoff ist als Baumaterial für Schalentiere und andere Meeresorganismen sehr beliebt. Insgesamt die Ozeane 16-mal mehr Kohlenstoff als die Biosphäre an Land.

Die wichtigsten Ergebnisse der Sutdie sind:

- Landpflanzen und Böden können bis zu 30% mehr CO2 absorbieren als in früheren Modelle angenommen.

- Die Kohlenstoffspeicherung in diesen Ökosystemen ist vorübergehender als bisher angenommen. Das bedeutet, daß der von Menschen verursachte CO2-Ausstoß möglicherweise nicht so lang in der terrestrischen Biosphäre verbleibt, wie die aktuellen Modelle vermuten lassen.

- Die Diskrepanz in den Modellen ist auf die kurzlebigen oder nicht belebten Pflanzengewebe sowie die umfangreichen unterirdischen Pflanzenteile zurückzuführen.

Die Auswirkungen dieser Ergebnisse sind für Klimavorhersagen und die Erstellung einer wirksamen Klimapolitik von Bedeutung. Es unterstreicht die Notwendigkeit einer genaueren Darstellung des globalen Kohlenstoffzyklus in Klimamodellen. Diese erhöhte Aufnahme von CO2 durch Vegetation ist zwar ein positives Vorzeichen, erlöst uns jedoch nicht die Notwendigkeit, die Kohlenstoffemissionen zu reduzieren, um den Klimawandel zu bekämpfen.

Sie müssen angemeldet sein, um einen Kommentar zu veröffentlichen.